Hi,博客文章索引在这里~

从 Attention 的数学原理出发,逐步拆解 KV Cache 的产生原因、Prefill/Decode 的计算特征差异,以及 vLLM PagedAttention 的页式内存管理。

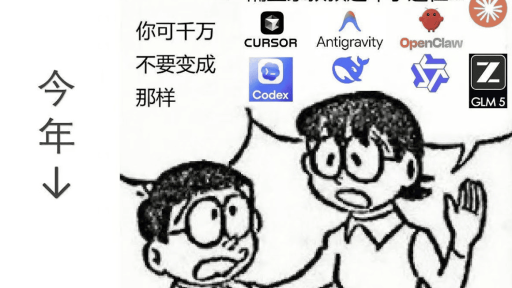

当 AI 助手开始读取代码、调用工具和执行命令,隐私问题就不再只是"会不会拿去训练"了。 0. 写在前面 这篇文章不是劝大家停止使用 AI 工具。笔者自己也很难回到没有 LLM Agent 的工作流里。 真正想讨论的问题是:我们正在把什么交给远端模型?这些数据经过哪些服务?谁能看见,谁能修改,谁能触发本地工具调用?出了问题以后,能不能审计和追责? 过去一两年,LLM Agent 正在从聊天窗口渗透到越来越多的实际工作流里。Cursor、Claude Code、Codex、Cline 这类工具让模…

面对 2015 年的老博客,是推翻重写还是爆改布局?借助最新 AI 模型结对,笔者仅用几个小时,完成了从前端排版到后端性能的全面现代化翻新。记一次时间性价比极佳的工程实践。

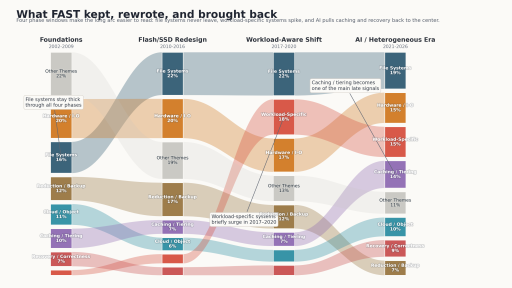

基于 FAST 2002–2026 论文集,本文梳理了存储系统研究从文件系统、Flash/SSD 到 KV cache、checkpoint 与 model loading 的迁移轨迹,重点讨论 AI 时代哪些老问题被重新推回了舞台中央。

本文是博主读 Fast Cloud Storage for AI Jobs via Grouped I/O API with Transparent Read/Write Optimizations 后的一些主观感想。

本文是博主读 FAST26 Sharpen the Spec, Cut the Code: A Case for Generative File System with SYSSPEC (Awarded Best Paper) 后的一些主观感想。

Cost-efficient Archive Cloud Storage with Tape: Design and Deployment

LESS is More for I/O-Efficient Repairs inErasure-Coded Storage

ACOS: Apple’s Geo-Distributed Object Store at Exabyte Scale

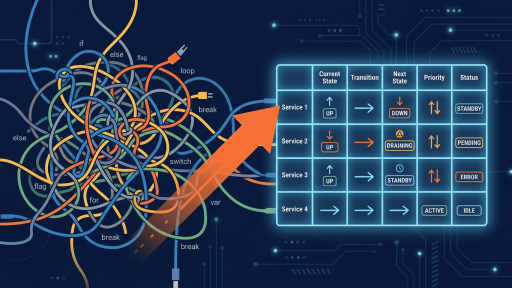

本文面向中重度使用 LLM coding 并思考未来开发范式的工程师,以及构建大型商业项目的一人公司开发者。本文描述 BMAD v6 的工作机制、与传统敏捷开发的关系,以及人类在流程中的位置。以及笔者实际体验的一些感受。