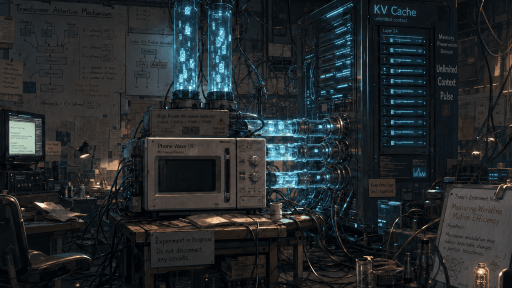

从 Attention 的数学原理出发,逐步拆解 KV Cache 的产生原因、Prefill/Decode 的计算特征差异,以及 vLLM PagedAttention 的页式内存管理。

📚 分布式存储漫游指南 - 绝赞连载中!

适合分布式系统开发者、学习者和对存储技术感兴趣的朋友。逐渐整理成开源书籍。如系列文章对您有帮助,请务必给个 ⭐ 支持下!万分感谢!

⭐ GitHub / 在线阅读💬 团子云技术 - 微信公众号

同步更新技术文章和快讯

扫码关注 第一时间获取 😁

最近评论

SPtuan 发布于 7 天前(05月19日)

tju pt 发布于 1 周前(05月17日)

SPtuan 发布于 2 周前(05月11日)

SPtuan 发布于 2 周前(05月11日)

millie 发布于 2 周前(05月10日)

热门主题 & 页面

归档

- 2026 年 5 月

- 2026 年 4 月

- 2026 年 3 月

- 2026 年 2 月

- 2026 年 1 月

- 2025 年 12 月

- 2025 年 11 月

- 2025 年 10 月

- 2025 年 9 月

- 2025 年 8 月

- 2025 年 7 月

- 2025 年 5 月

- 2025 年 3 月

- 2024 年 12 月

- 2024 年 9 月

- 2024 年 8 月

- 2024 年 5 月

- 2024 年 3 月

- 2024 年 2 月

- 2023 年 12 月

- 2023 年 11 月

- 2023 年 9 月

- 2023 年 8 月

- 2023 年 4 月

- 2023 年 1 月

- 2022 年 12 月

- 2022 年 10 月

- 2022 年 9 月

- 2022 年 7 月

- 2022 年 6 月

- 2022 年 2 月

- 2021 年 12 月

- 2021 年 11 月

- 2021 年 2 月

- 2021 年 1 月

- 2020 年 9 月

- 2020 年 4 月

- 2020 年 3 月

- 2020 年 1 月

- 2019 年 8 月

- 2019 年 7 月

- 2019 年 5 月

- 2019 年 4 月

- 2019 年 3 月

- 2019 年 2 月

- 2018 年 12 月

- 2018 年 10 月

- 2018 年 9 月

- 2018 年 8 月

- 2018 年 5 月

- 2018 年 2 月

- 2018 年 1 月

- 2017 年 11 月

- 2017 年 9 月

- 2017 年 7 月

- 2017 年 6 月

- 2017 年 5 月

- 2017 年 4 月

- 2017 年 3 月

- 2017 年 2 月

- 2017 年 1 月

- 2016 年 12 月

- 2016 年 11 月

- 2016 年 10 月

- 2016 年 9 月

- 2016 年 8 月

- 2016 年 7 月

- 2016 年 6 月

- 2016 年 5 月

- 2016 年 4 月

- 2016 年 3 月

- 2016 年 2 月

- 2016 年 1 月

- 2015 年 12 月

- 2015 年 11 月

- 2015 年 9 月

标签云